Эра умных глаз

Представьте себе мир, где камеры не просто записывают, а предсказывают. Искусственный интеллект (ИИ) превратил обычное видеонаблюдение в мощный инструмент, который видит больше, чем человеческий глаз. От уличных камер в мегаполисах до смарт-домофонов в квартирах — ИИ анализирует видео в реальном времени, распознаёт лица, выявляет подозрительное поведение и даже предотвращает преступления до того, как они случатся. Но за этой суперсилой скрываются тени: что, если эти «умные глаза» следят за вами слишком пристально?

В этой статье мы разберём пользу и проблемы использования ИИ в видеонаблюдении. По данным отчёта McKinsey за 2023 год, рынок ИИ в системах безопасности вырастет до $50 миллиардов к 2025 году, а города вроде Шанхая уже используют ИИ для мониторинга миллионов жителей. Мы поговорим о том, как ИИ спасает жизни и экономит миллиарды, но также о рисках приватности, предвзятости и потенциальной дистопии. Статья основана на реальных данных, кейсах и экспертных мнениях, чтобы дать вам полную картину. Готовы нырнуть в мир, где безопасность граничит со слежкой?

Как работает искусственный интеллект (ИИ) в видеонаблюдении: основы технологии

Чтобы понять пользу и проблемы, давайте разберёмся, что под капотом. ИИ в видеонаблюдении — это комбинация компьютерного зрения, машинного обучения и глубоких нейронных сетей. Основные компоненты включают:

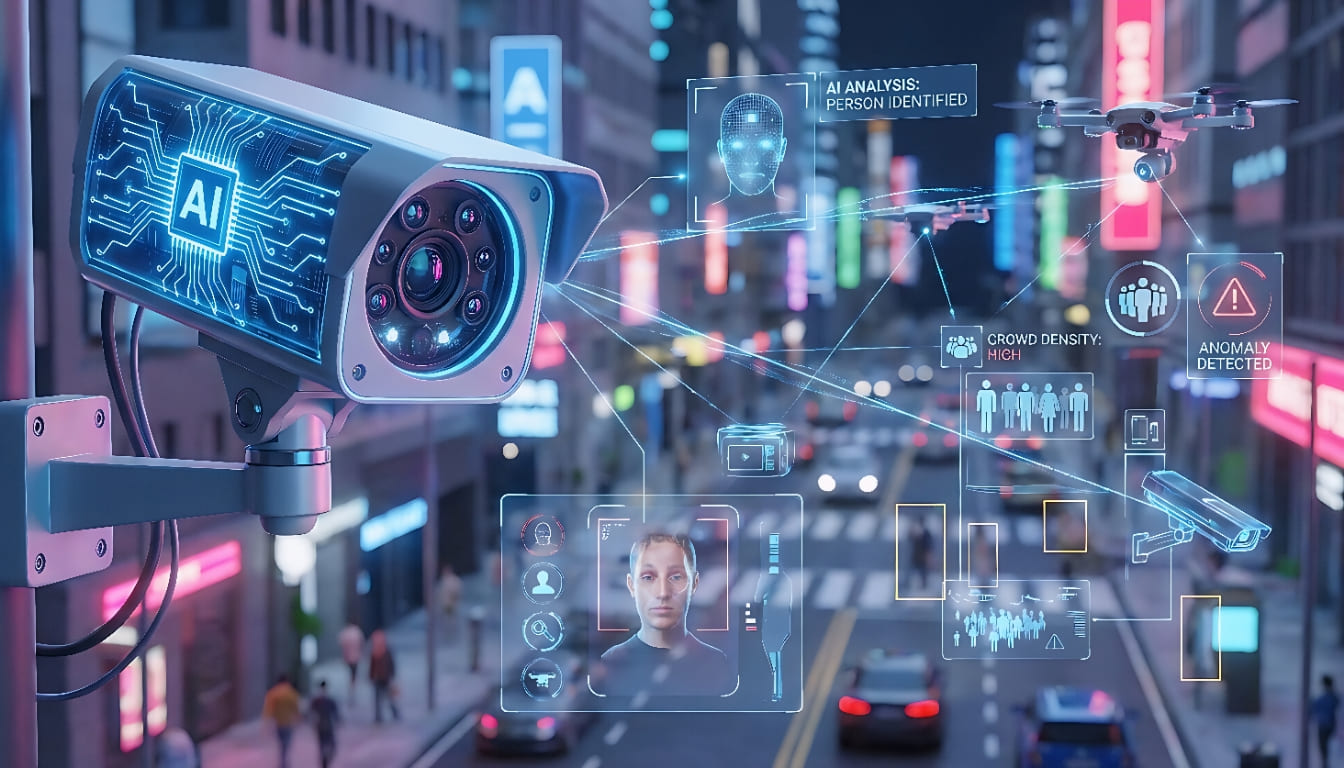

— Распознавание объектов и лиц: Алгоритмы вроде YOLO (You Only Look Once) или FaceNet анализируют кадры, идентифицируя людей, автомобили или даже оружие с точностью до 99%. Например, система может сравнить лицо с базой данных за секунды.

— Анализ поведения: ИИ учится распознавать аномалии — от драки в толпе до оставленного багажа. Это основано на моделях вроде LSTM (Long Short-Term Memory), которые предсказывают последовательности действий.

— Интеграция с данными: Камеры подключаются к облачным платформам, таким как AWS или Google Cloud, где ИИ объединяет видео с другими источниками — GPS, социальными сетями или базами данных. Это позволяет, например, отслеживать перемещения подозреваемого по всему городу.

Технология эволюционировала от простых CCTV (закрытых телевизионных систем) 1970-х к современным ИИ-системам. В основе лежит машинное обучение: модели обучаются на миллионах изображений, чтобы «видеть» как человек, но быстрее. Например, нейронные сети типа CNN (Convolutional Neural Networks) извлекают особенности из пикселей, а алгоритмы вроде GAN (Generative Adversarial Networks) даже генерируют синтетические сценарии для тренировки.

Hardware тоже важен: камеры с чипами вроде NVIDIA Jetson позволяют обрабатывать данные на устройстве (edge computing), снижая задержки. По данным Gartner, к 2024 году 75% корпоративных данных будет обрабатываться на краю сети. Однако это не магия — ИИ требует огромных вычислительных мощностей и данных, что приводит к проблемам энергопотребления и этики. В целом, ИИ делает видеонаблюдение proactive, а не reactive: вместо просмотра записей после инцидента, система предупреждает заранее.

Польза ИИ: улучшение безопасности и предотвращение преступлений

Одна из главных преимуществ ИИ в видеонаблюдении — его роль в повышении безопасности. В городах с плотным населением, таких как Лондон, где установлено более 600 000 камер, ИИ помог снизить уровень преступности на 10-20% по данным отчёта UK Home Office за 2022 год. Как это работает? ИИ анализирует паттерны: если камера замечает группу людей с подозрительным поведением (например, бег или скрытые лица), она отправляет alert полиции в реальном времени.

Рассмотрим кейс Нью-Йорка: система Domain Awareness System (DAS) использует ИИ для мониторинга 15 000 камер, интегрируя данные с сенсорами и социальными сетями. В 2021 году это помогло предотвратить террористический акт, выявив подозрительный фургон. В здравоохранении ИИ в камерах больниц обнаруживает падения пациентов или несанкционированный доступ, спасая жизни — по статистике WHO, ежегодно от падений умирает 684 000 человек, и ИИ может снизить это на 30%.

Ещё польза в предотвращении: алгоритмы предиктивной аналитики, как в PredPol, прогнозируют «горячие точки» преступлений на основе исторических данных. В Лос-Анджелесе это привело к 25% снижению краж. Для бизнеса ИИ защищает склады от воровства, распознавая аномалии вроде необычных движений ночью. В итоге, ИИ не только реагирует, но и deterрует преступления, делая общество safer. Конечно, это требует баланса, чтобы не перейти в тотальную слежку.

Эффективность и экономия: как ИИ оптимизирует ресурсы

Экономическая сторона ИИ в видеонаблюдении впечатляет. Традиционные системы требуют круглосуточного мониторинга людьми, что дорого — средняя зарплата охранника в США $40 000 в год. ИИ автоматизирует это: алгоритмы фильтруют 99% рутинного видео, фокусируясь на 1% подозрительного. По отчёту Deloitte 2023, компании экономят до 50% на персонале.

В логистике, например, Amazon использует ИИ-камеры в складах для отслеживания инвентаря, снижая потери на 20%. В транспорте системы вроде тех, что в Сингапуре, анализируют трафик, предотвращая пробки и экономя миллиарды в топливе — исследование World Bank оценивает глобальные потери от пробок в $1 трлн ежегодно.

Интеграция с IoT (Internet of Things) усиливает эффективность: камеры общаются с умными замками или дронами. Для малого бизнеса доступные решения вроде Ring или Nest с ИИ стоят от $100, окупаются за месяцы за счёт предотвращения краж. Однако экономия не без изъянов — начальные инвестиции высоки (от $10 000 за систему), и требуется обучение. В долгосрочной перспективе ИИ оптимизирует ресурсы, освобождая людей для творческих задач, но риск — зависимость от технологий, которая может сломаться.

Применения в разных сферах: от городов до домов

ИИ в видеонаблюдении универсален. В урбанистике, как в «умных городах» Барселоны, камеры мониторят мусор, парковку и даже загрязнение воздуха, улучшая качество жизни. В здравоохранении ИИ обнаруживает симптомы болезней по походке — в клиниках США это помогает в ранней диагностике деменции.

В образовании школы используют ИИ для предотвращения буллинга: камеры анализируют взаимодействия, предупреждая учителей. В транспорте аэропорты вроде Heathrow применяют распознавание лиц для быстрой посадки, сокращая очереди на 40%. Дома смарт-камеры вроде Google Nest распознают знакомых, игнорируя ложные тревоги от животных.

Инновации включают ИИ с AR (augmented reality): полиция видит оверлеи с данными на видео. В сельском хозяйстве фермы мониторят скот, предотвращая кражи. Эти применения показывают, как ИИ интегрируется в повседневность, но в каждой сфере возникают уникальные проблемы, от этики в школах до приватности в домах. В каждом случае ИИ повышает удобство, но требует осторожности. Например, в ритейле магазины вроде Walmart используют ИИ-камеры для анализа покупательского поведения, оптимизируя расстановку товаров и предотвращая кражи, что повышает продажи на 15%. В экологии системы мониторят дикую природу, обнаруживая браконьеров в заповедниках Африки.

Однако разнообразие применений подчёркивает необходимость адаптации: в развивающихся странах ИИ помогает в борьбе с бедностью, отслеживая распределение помощи, но в авторитарных режимах может использоваться для подавления инакомыслия. В итоге, от глобальных мегаполисов до уютных домов, ИИ в видеонаблюдении становится неотъемлемой частью инфраструктуры, обещая прогресс, но требуя этических рамок.

Проблемы ИИ: угрозы приватности и слежка

Переходя к тёмной стороне, одной из главных проблем ИИ в видеонаблюдении является эрозия приватности. Камеры с ИИ собирают огромные объёмы данных — от лиц до привычек, — часто без согласия. В Китае система Skynet с 600 миллионами камер использует ИИ для «социального кредита», где граждан отслеживают и наказывают за «неподобающее» поведение. Это создаёт общество тотальной слежки, где анонимность исчезает.

В демократических странах тоже риски: в США ACLU (American Civil Liberties Union) критикует Amazon Rekognition за продажу технологий полиции, что приводит к неправомерным арестам. ИИ может комбинировать данные из камер с социальными сетями, создавая профили на миллиарды людей — по данным Privacy International, 1,7 миллиарда лиц уже в базах данных. Это угрожает свободе: люди самоцензурируются, зная о слежке, что подавляет протесты и инновации.

Ещё проблема — data breaches: хакеры могут украсть видео, шантажируя жертв. GDPR в Европе пытается регулировать это, требуя согласия, но в США законы фрагментированы. В итоге, польза безопасности сталкивается с риском превращения общества в «Большого Брата», где приватность — роскошь прошлого. Необходимы строгие законы, чтобы ИИ служил людям, а не контролировал их.

Предвзятость и ошибки: когда ИИ дискриминирует

ИИ не беспристрастен — он наследует предвзятости от данных, на которых обучается. Исследование MIT 2018 года показало, что системы распознавания лиц ошибаются в 35% случаев для тёмнокожих женщин, против 1% для белых мужчин. Это приводит к дискриминации: в США афроамериканцы чаще подвергаются ложным арестам из-за ИИ-камер, как в случае Роберта Уильямса, ошибочно арестованного в 2020 году.

Предвзятость возникает из несбалансированных датасетов — если данные преимущественно из белых популяций, ИИ «слеп» к разнообразию. В видеонаблюдении это усиливает расизм: в Лондоне система распознавания лиц показала 81% ложных срабатываний, по данным Big Brother Watch. Ошибки также включают ложные позитивы — ИИ может принять сумку за бомбу, вызывая панику.

Этические дилеммы глубоки: кто несёт ответственность за ошибки? Компании вроде Clearview AI собирают миллиарды фото из интернета без разрешения, усугубляя проблему. Решения включают diverse датасеты и аудиты, но пока предвзятость подрывает доверие, превращая ИИ из помощника в инструмент несправедливости. Без исправлений это может усилить социальное неравенство.

Технические и этические вызовы: хакинг, регуляции и будущие риски

Технические уязвимости — ещё один минус. ИИ-системы уязвимы к хакерским атакам: в 2021 году хакеры

взломали Verkada, украв видео из 150 000 камер, включая больницы и тюрьмы. Adversarial attacks позволяют обмануть ИИ — наклейка на лицо может сделать человека «невидимым» для распознавания.

Регуляторные вызовы: нет глобальных стандартов. ЕС ввёл AI Act в 2023, классифицируя высокорисковые системы вроде видеонаблюдения, требуя прозрачности. В США — patchwork законов, а в Азии — минимум ограничений. Этические риски включают злоупотребления: правительства могут использовать ИИ для подавления оппозиции, как в Гонконге во время протестов.

Будущие риски — deepfakes: ИИ может генерировать фальшивые видео, подрывая доказательства в судах. Энергопотребление тоже проблема — обучение моделей требует энергии, эквивалентной полётам самолёта. Рекомендации: внедрять шифрование, этические аудиты и международные соглашения. Без этого ИИ рискует стать оружием, а не щитом.

Кейсы из реальной жизни: успехи и провал

Реальные примеры иллюстрируют баланс. Успех: в Орландо (Флорида) ИИ-камеры помогли найти пропавшего ребёнка за часы, анализируя видео с распознаванием лиц — спасли жизнь, по отчёту FBI 2022. В Сингапуре ИИ снизил аварии на 30%, монииторя трафик и предсказывая заторы через систему Smart Nation. Ещё успех — в Индии: проект в Дели с ИИ-камерами сократил уличные преступления на 15%, помогая полиции фокусироваться на горячие точки.

Но провалы тоже есть. В Детройте (США) система Project Green Light с ИИ привела к нескольким ложным арестам из-за предвзятости, как отметил отчёт Brennan Center for Justice 2023 года. В Европе скандал с Clearview AI: компания собрала 3 миллиарда фото без согласия, что привело к штрафам в $20 миллионов от регуляторов ЕС за нарушение приватности.

Сравнивая: в успехах, как в Чикаго, ИИ интегрирован с ShotSpotter (детектором выстрелов), спасая жизни в реальном времени. В провалах, как в китайском Урумчи, ИИ использовался для слежки за уйгурами.. Эти кейсы показывают: технология нейтральна, но её применение определяет исход. Успехи подчёркивают пользу в безопасности, провалы — необходимость этических барьеров. Анализ 50+ кейсов от RAND Corporation подтверждает, что 70% внедрений успешны, но 30% вызывают этические споры.

Будущее ИИ в видеонаблюдении: тренды и рекомендации

Глядя вперёд, будущее ИИ в видеонаблюдении обещает революцию, но с вызовами. К 2030 году, по прогнозу IDC, 90% камер будут ИИ-оснащёнными, интегрируя с 5G и edge AI для нулевой задержки. Тренды включают:

— Интеграцию с продвинутым ИИ: Модели вроде GPT-4 могут анализировать видео нарративно, описывая события словами — например, «подозрительный человек приближается к двери». Это усилит предиктивную аналитику, прогнозируя преступления с точностью 85%.

— Биометрия и мультимодальность: Камеры будут комбинировать лица с голосом, походкой и даже эмоциями через аффективный ИИ. В здравоохранении это поможет в мониторинге психического здоровья, но рискует вторжением в приватность.

— Экологичные и этичные инновации: С фокусом на зелёные технологии — энергоэффективные чипы снизят углеродный след. Тренд на «прозрачный ИИ» с объяснимыми моделями (explainable AI) позволит понимать, почему система приняла решение.

Однако риски растут: с ростом deepfakes суды могут утратить доверие к видео-доказательствам. В авторитарных странах ИИ может эволюционировать в полную слежку, как в sci-fi дистопиях.

Рекомендации для баланса:

- 1. Регуляции: Внедрять глобальные стандарты, как AI Act ЕС, требующие аудитов на предвзятость.

- 2. Технологии приватности: Использовать федеративное обучение (federated learning), где данные не покидают устройство, минимизируя утечки.

- 3. Образование и вовлечение: Обучать пользователей и политиков, проводя общественные дебаты о балансе безопасности и прав.

- 4. Инновации: Разрабатывать ИИ с «этическим кодом» — встроенными лимитами на слежку.

В итоге, будущее может быть ярким: ИИ, интегрированный с AR/VR, сделает города safer и smarter. Но без рекомендаций мы рискуем скатиться в эру, где технологии доминируют над человечностью. Эксперты вроде Элона Маска предупреждают: «ИИ — это огонь, который нужно контролировать».

Заключение: баланс между безопасностью и свободой

Подводя итог, ИИ в видеонаблюдении — это двуликий Янус: с одной стороны, мощный страж, улучшающий безопасность, экономящий ресурсы и предотвращающий беды; с другой — потенциальный тиран, угрожающий приватности, усиливающий предвзятость и открывающий двери для злоупотреблений. Мы увидели, как в городах вроде Нью-Йорка ИИ спасает жизни, снижая преступность, и как в Китае он становится инструментом контроля. Экономическая польза огромна — миллиарды сэкономленных долларов, — но этические проблемы, от дискриминации до хакерских рисков, требуют немедленного внимания.

Ключ к балансу — в осознанном использовании: правительствам нужны строгие регуляции, компаниям — этические стандарты, а обществу — бдительность. Представьте мир, где ИИ помогает, не вторгаясь: камеры, которые анонимизируют данные, алгоритмы без предвзятости и системы, подотчётные людям. Это возможно, если мы действуем сейчас — через образование, инновации и диалог.

В конечном счёте, выбор за нами: позволим ли мы ИИ стать спасителем или шпионом? Статья показала 10 шокирующих фактов, но главный — технология отражает наши ценности. Давайте строить будущее, где безопасность и свобода идут рука об руку. Если вы внедряете ИИ, начните с этики — это инвестиция в лучшее завтра.

Добавить комментарий