Эта статья — подробный, но понятный путеводитель по миру практического машинного обучения и искусственного интеллекта. Она объясняет, с чего начать обучение, какие знания и инструменты понадобятся, как готовить данные и как создавать, оценивать и развёртывать модели. Статья ориентирована на обычного читателя без глубокой технической подготовки, но стремится дать полный обзор важных тем и практических шагов для самостоятельного старта и устойчивого прогресса в направлении создания собственных моделей искусственного интеллекта (ИИ).

Многие слышали об искусственном интеллекте и видели его проявления в продуктах — умные подсказки, распознавание речи, генерация текстов и изображений. За этими возможностями стоят модели, которые учатся на данных, находят закономерности и применяют их для выполнения задач. Для того чтобы начать создавать свои модели, не нужно быть гением математики или обладать десятилетним опытом программирования. Нужны системность, понимание ключевых идей и умение шаг за шагом строить проекты. Эта статья даёт именно такой «шаговый» и всесторонний маршрут: от фундаментальных понятий до практических навыков, от инструментов до релиза модели в продуктивной среде.

Что такое модель искусственного интеллекта и почему это важно

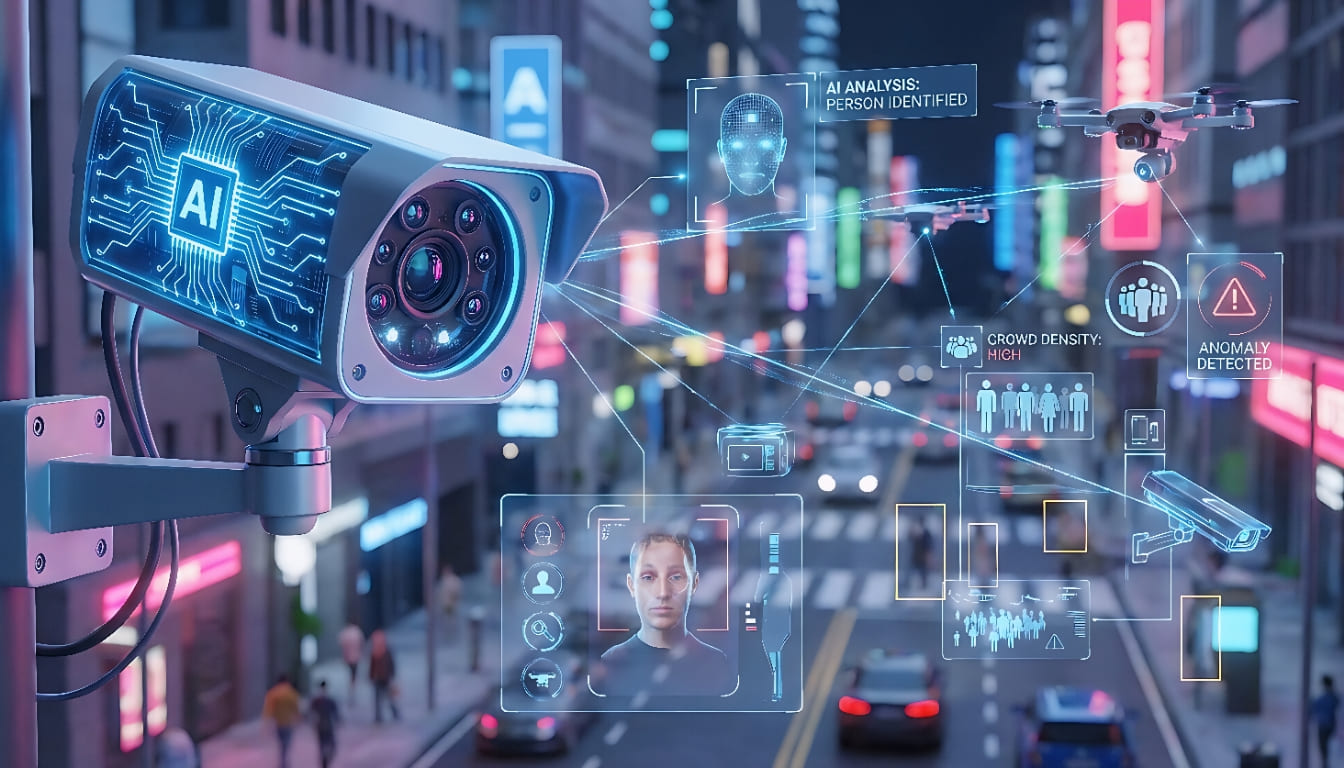

Модель искусственного интеллекта — это алгоритм или набор алгоритмов, которые на основе входных данных делают прогнозы, принимают решения или генерируют информацию. В широком смысле под ИИ понимают систему, способную решать задачи, для которых раньше требовались человеческие навыки: распознавать объекты, понимать язык, рекомендовать товары, оптимизировать процессы.

Почему модели важны:

— Они автоматизируют повторяющиеся или объёмные задачи, экономя время и ресурсы.

— Они способны находить скрытые закономерности в данных, что открывает новые инсайты.

— Правильно спроектированная модель улучшает качество решений в медицине, финансах, производстве, образовании и многих других сферах.

Важно понимать, что модель — это инструмент, а не волшебник. Её качество определяется данными, постановкой задачи и процессом разработки. Без ясного понимания, что вы хотите получить и какие данные доступны, любая модель быстро перестанет быть полезной.

Какие знания и мышление нужны

Перед тем как окунуться в практику, полезно понять, какие навыки будут опорой.

Основные типы знаний:

— Базовая математическая грамотность: понимание алгебры, вероятностей и статистики. Не обязательно глубокие доказательства, но важны понятия среднего, дисперсии, корреляции, базовой теории вероятности и понимание функций.

— Линейная алгебра в понимании: вектор, матрица, умножение матриц — на интуитивном уровне. Эти понятия встречаются в описании того, как работают нейронные сети.

— Основы программирования: умение писать программы на одном языке, в большинстве случаев на Python. Важно уметь читать документацию, устанавливать пакеты, работать с файлами и простыми скриптами.

— Навыки работы с данными: умение загружать, очищать, преобразовывать данные и визуализировать их.

— Научный подход: выстраивание гипотез, проведение экспериментов, контроль переменных, честная оценка результатов.

— Продуктовое мышление: умение формулировать проблему так, чтобы модель решала реальную задачу, а не техническую игрушку.

Мягкие навыки:

— Терпение и системность. Быстро научиться всему невозможно, успех приходит из последовательных усилий.

— Критическое мышление. Не верьте сразу результату модели — проверяйте и критически анализируйте.

— Умение объяснять. Важно ошибаться прозрачно и уметь объяснить результаты нетехнической аудитории.

Уровни подготовки:

— Начальный: базовая грамотность в Python, знакомство с понятием модели и простыми статистическими методами.

— Средний: знание библиотек для работы с данными, понимание основ машинного обучения, умение создавать и оценивать простые модели.

— Продвинутый: глубокое понимание нейронных сетей, опыт в обучении и развёртывании моделей, знание MLOps практик.

Базовый учебный маршрут: шаг за шагом

Этот раздел описывает учебный маршрут от абсолютного новичка до того уровня, когда вы сможете самостоятельно запускать проекты и развёртывать модели.

Шаг 1. Ознакомление с общими понятиями

— Что такое данные, модель, обучение, тест, переобучение, обобщение.

— Разница между классическим машинным обучением и глубоким обучением.

— Понимание цикла разработки: от постановки задачи до мониторинга модели в эксплуатации.

Шаг 2. Изучение Python и работы с данными

— Основы синтаксиса Python: переменные, функции, циклы, условия.

— Работа с данными: форматы CSV, JSON, чтение и запись, базовые преобразования.

— Библиотеки: знакомство с NumPy и pandas как инструментами для манипуляции данными.

— Визуализация: знакомство с библиотеками для визуализации данных, понимание графиков и их интерпретации.

Шаг 3. Введение в статистику и вероятности

— Описательная статистика: среднее, медиана, мода, дисперсия, стандартное отклонение.

— Корреляция и причинность — почему корреляция не равна причинности.

— Основы вероятности: понятие случайной величины, распределения, основные типы распределений.

Шаг 4. Классические алгоритмы машинного обучения

— Разделение на обучающую и тестовую выборки, кросс-валидация.

— Простые алгоритмы: линейная регрессия, логистическая регрессия, деревья решений, k‑ближайших соседей.

— Оценка моделей: базовые метрики и их смысл.

Шаг 5. Глубокое обучение и нейронные сети

— Понимание нейрона: входы, веса, функция активации.

— Архитектура сети: слои, прямой проход, обратное распространение ошибки.

— Типы сетей: полносвязные, сверточные, рекуррентные, трансформеры — базовое представление.

— Практические библиотеки: знакомство с PyTorch или TensorFlow.

Шаг 6. Практика на реальных задачах

— Проекты небольшой сложности: прогнозирование числовой величины, классификация текстов, распознавание образов.

— Структура проекта: сбор данных, очистка, исследовательский анализ, построение модели, оценка, подготовка к развёртыванию.

Шаг 7. Инструменты для экспериментов и работы в команде

— Контроль версий (git), рабочие среды (Jupyter, VSCode), контейнеризация (Docker).

— Репозиторий артефактов: хранение кода, данных и результатов экспериментов.

Шаг 8. MLOps, развёртывание и эксплуатация

— Понимание, как модель попадает в приложение: экспорт, создание API, контейнеризация, развёртывание в облаке.

— Мониторинг качества модели, обнаружение дрейфа, обновления и управление версиями.

Этот маршрут не предполагает жёсткой последовательности: многие шаги можно проходить параллельно, а знания лучше закреплять практикой. Важно иметь хоть один реальный проект, даже небольшой, где вы пройдёте все этапы.

Инструменты и программная среда

Для практики в современных условиях достаточно набора открытых и коммерческих инструментов. Здесь описаны категории инструментов и конкретные популярные варианты, с объяснением их роли.

Язык программирования

— Python — де-факто стандарт в области ИИ и ML. Богатая экосистема библиотек, большое сообщество, учебные материалы. Альтернативы существуют, но для старта Python — лучший выбор.

Интерактивная работа и ноутбуки

— Jupyter Notebook / JupyterLab — удобны для экспериментов, визуализации и документирования. Позволяют по шагам показывать результаты и сохранять исследования.

— Google Colab — облачная версия, где доступны GPU и CPU бесплатно или по подписке. Удобно для быстрого старта без настройки окружения.

— VSCode с расширениями — более профессиональная среда для разработки и интеграции с git, контейнерами и отладкой.

Библиотеки для работы с данными

— NumPy — базовые операции с массивами, линейная алгебра.

— pandas — удобная работа с табличными данными: загрузка, очистка, агрегирование.

— Matplotlib, Seaborn, Plotly — визуализация данных.

Библиотеки машинного обучения

— scikit-learn — стандарт для классических алгоритмов: регрессия, классификация, кластеризация, трансформации фичей. Идеальна для начальных проектов и быстрой прототипизации.

— XGBoost, LightGBM, CatBoost — градиентные бустинг‑библиотеки, мощны для табличных данных.

Библиотеки глубокого обучения

— PyTorch — гибкая и широко используемая библиотека, популярная у исследователей и инженеров. Удобна для отладки, экспериментов и обучения моделей.

— TensorFlow / Keras — зрелая экосистема с инструментами для продакшна. Keras предоставляет высокоуровневый интерфейс.

Инструменты для обработки естественного языка (NLP)

— Hugging Face Transformers — набор готовых архитектур (включая трансформеры) и инструментов для загрузки/тонкой настройки предобученных моделей.

— spaCy — библиотека для быстрого NLP: токенизация, разметка, векторные представления.

Инструменты для компьютерного зрения

— OpenCV — базовая библиотека для обработки изображений и видео.

— torchvision и специализированные модели в PyTorch и TensorFlow.

Инструменты для MLOps и отслеживания экспериментов

— MLflow — трекинг экспериментов, управление моделями, развертывание.

— Weights & Biases — платформа для логирования экспериментов, визуализации и совместной работы.

— DVC — версия данных и интеграция с git.

Инфраструктура и облачные сервисы

— AWS, Google Cloud и Azure предоставляют compute, GPU/TPU, хранилища и управляемые сервисы для моделей.

— Heroku, Render, Vercel — простые платформы для развёртывания веб‑сервисов с моделями.

— Docker — контейнеризация приложений, упрощает переносимость и развёртывание.

Инструменты для генерации и интеграции (LLM и др.)

— Hugging Face Hub — хранилище моделей и датасетов. Позволяет быстро получить предобученные модели.

— LangChain и аналогичные библиотеки — помогают строить приложения вокруг больших языковых моделей, управлять промптингом и цепочками вызовов.

Инструменты контроля качества и безопасности

— Bandit, pylint — статический анализ кода.

— Инструменты для тестирования производительности и нагрузочного тестирования.

Выбор инструментов зависит от задачи и этапа: для экспериментов достаточно ноутбука и Python; для продакшна потребуется контейнеризация, CI/CD и мониторинг.

Данные: сердце любого проекта ИИ

Данные — ключевой ресурс. Качество решения напрямую зависит от качества данных. Здесь описана логика работы с данными, необходимые операции и принципы управления.

Понимание типов данных

— Табличные данные — строки и столбцы: структуры со свойствами объектов. Часто встречаются в бизнесе.

— Текст — неструктурированные последовательности символов и слов. Требуют специфической обработки: токенизация, приведение к формам.

— Изображения и видео — матричные структуры, требуют обработки и нормализации.

— Звуковые данные — последовательности амплитуд, требуют преобразований (например, спектрограммы).

— Временные ряды — последовательности измерений по времени, требуют учёта автокорреляции.

Этапы работы с данными

1. Определение необходимых данных — какие признаки потребуются для решения задачи.

2. Сбор и доступ — получение данных из файлов, баз данных, API или генерация синтетических данных.

3. Оценка качества — проверка полноты, ошибок, выбросов, форматов и пропусков.

4. Очистка и предобработка — обработка пропусков, устранение

дубликатов, нормализация и приведение типов.

5. Извлечение признаков (feature engineering) — создание новых переменных из исходных данных, агрегация, преобразования.

6. Разделение на обучающую/валидационную/тестовую выборки — обеспечить честную оценку модели.

7. Хранение и версионирование — хранение набора данных в управляемом виде, документирование происхождения и ограничений.

Качество данных и основные проблемы

— Пропуски (missing values) — нужно решить, как их обрабатывать: удалять строки, заполнять медианой/средним, прогнозировать значения.

— Систематические ошибки — ошибки измерения, неверная разметка, устаревшие данные.

— Смещение выборки — данные не репрезентативны для реальной популяции; модели будут плохо работать на новых данных.

— Дубликаты и шумиха — одинаковые записи или выбросы, искажающие обучение.

— Неправильные форматы и единицы измерения — важны при объединении данных из разных источников.

Сбор данных: практические и этические аспекты

— Источники: публичные датасеты, открытые репозитории, данные компании, API сторонних сервисов, веб‑скрапинг, датчики.

— Лицензии и права: проверяйте лицензию датасета, права на использование и ограничения. Некоторые данные можно использовать для обучения, но нельзя публиковать результаты без согласия.

— Приватность: защищайте персональные данные и соблюдайте требования законодательства. Анонимизация не всегда достаточна — важно оценивать риск ре-идентификации.

Разметка данных и аннотация

— Для задач классификации, детекции объектов, сегментации нужна качественная разметка.

— Разметка может быть ручной, полуавтоматической или краудсорсинговой.

— Важны инструкции для аннотаторов, проверка качества и тестовые кейсы для контроля.

Аугментация и синтетические данные

— Техники аугментации позволяют увеличить объём тренировочных данных: повороты и сдвиги для изображений, замена синонимов для текста, шум для сигналов.

— Синтетические данные генерируют искусственно, когда реальные данные недоступны или ограничены. Это мощный инструмент, но важно, чтобы синтетика отражала реальные распределения.

Документирование данных

— Datasheets — формализованный документ, описывающий происхождение, структуру, ограничения и предполагаемые сценарии использования набора данных.

— Ведение журнала изменений и версий данных — кто и когда вносил изменения и почему.

Практика качества данных: EDA

— Исследовательский анализ данных (EDA) — ключевой этап. Включает визуализацию распределений, корреляций, исследование выбросов и аномалий. EDA помогает сформулировать гипотезы о важных признаках и потенциальных проблемах.

Хранение и управление

— Храните сырые данные отдельно от предобработанных и используйте контроль версий.

— Для больших наборов используйте хранилища объектов (S3 и аналоги) и базы данных с оптимизированной индексацией.

— Учитывайте требования к защите данных: шифрование, контроль доступа и аудит.

Как строятся модели: от идеи до результата

Этот раздел описывает практический процесс: шаги, которые проходят при создании модели.

1. Формулировка задачи

— Чётко опишите бизнес‑цель или исследовательский вопрос. Что является входом и ожидаемым выходом? Как будет использоваться результат? Какой средой он должен оперировать?

— Опишите ограничения: скорость, точность, объяснимость, приватность.

2. Выбор метрики и целевой функции

— Выберите метрику, которая отражает реальную ценность. Для классификации это может быть точность, точность при определённом пороге, AUC; для регрессии — RMSE или MAE. Важно, чтобы метрика совпадала с бизнес‑целями.

3. Базовая модель (baseline)

— Начните с простого решения: простая линейная модель или дерево решений. Это даст базовую точку отсчёта и позволит оценить, действительно ли сложные модели приносят улучшение.

4. Предобработка и фичеринжиниринг

— Кодирование категориальных признаков, нормализация числовых, создание новых признаков через комбинации, агрегации по временным окнам.

— Отбор признаков: удаление малоинформативных или коррелированных переменных.

5. Выбор модели и обучение

— На базе задачи и данных выбирается тип модели. Для табличных данных часто дают хороший результат модели бустинга. Для текста и изображений — нейронные сети.

— Разделите данные правильно: train/validation/test. Используйте кросс‑валидацию, если данных мало.

6. Подбор гиперпараметров

— Грид‑поиск, случайный поиск, байесовская оптимизация — методы выбора оптимальных гиперпараметров.

— Не забывайте про правило: гиперпараметры подбираются на валидационной выборке, тестовая используется только для финальной оценки.

7. Проверка устойчивости и проверка на смещение

— Оцените модель на разных сегментах данных: по времени, географии, демографии. Это показывает, насколько модель обобщает и где возможны проблемы.

8. Энсамблирование и улучшения

— Комбинация нескольких моделей может улучшить качество, но повышает сложность. Используйте, если действительно нужен прирост.

9. Финальная оценка и подготовка к развёртыванию

— Финальная модель фиксируется, сохраняются версии кода и данных, создаются артефакты: модельный файл, скрипты предобработки, документация.

10. Документация

— Model card — документ, описывающий назначение модели, ограничения, метрики, дату последние обучения и ответственных лиц. Обязателен для продакшн‑проектов.

Важно: итеративность. Большая часть работы — эксперименты, анализ результатов и корректировки. Хорошая практика — фиксировать результаты и гипотезы.

Оценка моделей и правильные метрики

Правильная оценка модели — основа честного и устойчивого развития. Неправильная метрика ведёт к оптимизации «на бумаге» и провалу в реальности.

Выбор метрик

— Классификация: accuracy, precision, recall, F1, ROC AUC, PR AUC. Каждая метрика полезна в разных ситуациях. Например, при диспропорции классов accuracy вводит в заблуждение.

— Регрессия: MAE, MSE, RMSE, R2. MSE штрафует за большие ошибки сильнее.

— Ранжирование: NDCG, MAP — для задач рекомендации и поиска.

— Временные ряды: MAPE, SMAPE — проценты ошибок.

— Специализированные метрики: время отклика модели, пропускная способность, стоимость ошибок в бизнесе.

Валидация и переобучение

— Переобучение (overfitting) — модель слишком подгоняется под тренировочные данные и теряет способность обобщать. Противоядие: регуляризация, больше данных, упрощение модели, кросс‑валидация.

— Недообучение (underfitting) — модель слишком проста и не улавливает закономерности.

Кросс‑валидация

— K‑fold кросс‑валидация — разделение на K частей, обучение и валидация на разных комбинациях. Позволяет честно оценить модель при ограниченных данных.

— Time‑series split — при работе с временными рядами важно соблюдать порядок времени и не использовать «будущее» в прошлом.

Калибровка прогнозов

— Для задач, где важна корректная вероятность, калибровка предсказаний является критичной. Методы: Platt scaling, isotonic regression.

Анализ ошибок

— Посмотрите, где модель ошибается: определённые сегменты, редкие случаи, шумные данные. Анализ ошибок — источник идей для улучшений.

Оценка в реальных условиях

— Тестирование A/B — сравнение новой модели с существующей в живой среде. Показывает реальную полезность и скрытые эффекты.

— Пилоты на ограниченной аудитории — минимизируют риски и дают практические данные.

Развертывание, эксплуатация и MLOps

Создать модель — это половина дела. Другая половина — заставить её стабильно работать в продакшне.

Что такое развёртывание

— Развёртывание — процесс перевода модели из экспериментальной среды в систему, где ей пользуются реальные пользователи или процессы. Это включает API, сервисы, инфраструктуру и мониторинг.

Архитектура развёртывания

— Онлайн‑инференс: модель отвечает в режиме реального времени на запросы (низкая задержка). Требует оптимизации латентности и масштабирования.

— Батч‑инференс: модели обрабатывают данные партиями, подходят для периодических задач.

— Гибрид: комбинация быстрых упрощённых моделей для онлайн и точных для офлайн.

Контейнеризация и инфраструктура

— Docker — упаковка приложения и модели в контейнер, что облегчает переносимость.

— Оркестрация: Kubernetes — управление контейнерами в продакшне, масштабирование и балансировка.

— Серверы и облако: выбор провайдера и конфигурации зависит от нагрузки и бюджета.

Проблемы производительности

— Оптимизация модели: квантизация, прунинг, ускорение с помощью ONNX runtime или TensorRT.

— Кэширование результатов: уменьшение нагрузки путем хранения типичных ответов.

— Параллелизация: масштабирование на несколько машин.

Мониторинг и обнаружение дрейфа

— Мониторинг данных: сравнение распределений входных данных с тем, на которых обучалась модель.

— Мониторинг производительности: отслеживание метрик качества модели в реальном времени.

— Обнаружение дрейфа: статистические тесты, алерты и автоматические процедуры отката.

CI/CD для моделей

— Автоматизация тестирования, сборки и развёртывания моделей. Включает проверку кода, тесты на данные, контроль метрик и версии модели.

Управление версиями и реестр моделей

— Модель должна иметь чёткую версию, описание отличий и метрики. Model registry позволяет хранить и выбирать версии для продакшна.

Работа с данными в продакшне

— Потоки данных, обработка в реальном времени, обеспечение качества данных.

— Сохранение логов запросов и ответов для аудита и повторного обучения.

Обновления и откат

— Процедуры безопасного обновления модели: canary‑deployments, blue/green deploys, возможность отката к предыдущей версии.

Безопасность и доступ

— Ограничение доступа к API, аутентификация, защита секретов и контроль прав.

— Обеспечение целостности модели и кода, защиты от несанкционированного доступа.

Ответственный ИИ: этика, безопасность и прозрачность

Технологии дают мощь — вместе с ней появляется ответственность. Ответственный ИИ — не опция, а необходимость.

Проблемы и риски

— Смещение и дискриминация: модель может усилить существующие предвзятости.

— Нарушение приватности: корелляционные модели могут вытекать в реальное раскрытие личной информации.

— Непредсказуемость и уязвимость: модели могут вести себя непредсказуемо на редких входах или быть уязвимы к атаке.

— Прозрачность: пользователи должны понимать, как принимается решение, особенно в критичных областях.

Практики для ответственного развития

— AIA — оценки воздействия ИИ: анализ потенциального вреда и мер по снижению риска.

— Документация: model cards, datasheets и журналы экспериментов.

— Интерпретируемость и объяснимость: инструменты и методы для объяснения решений модели.

— Человека в петле: сохранять возможность вмешательства человека в критичных решениях.

— Тестирование на разнообразных данных: проверка производительности на разных демографических группах и сценариях.

— План реакции на инциденты: регламент действий при ошибках и жалобах пользователей.

Юридические и нормативные аспекты

— Законодательство по защите данных и отраслевые стандарты могут накладывать ограничения на сбор, хранение и использование данных.

— Понимайте требования к сертификации и аудиту для ваших применений (медицина, финансы и т.д.).

Этическое проектирование

— Принцип минимизации данных: собирайте только необходимые данные.

— Принцип прозрачности: объясняйте, где и как используется ИИ.

— Принцип подотчётности: кто несёт ответственность за решения модели? Укажите ответственных и процессы обжалования.

Продвинутые направления: LLM, мульти-модальные модели и др.

После освоения базовых практик открываются более сложные и современные темы.

Большие языковые модели (LLM)

— LLM — это модели, обученные на огромных корпусах текста и способные генерировать, обобщать и отвечать на вопросы. Они задают новые возможности и новые требования: инфраструктура, методы тонкой настройки и контроль поведения.

— Тонкая настройка (fine‑tuning) и методы адаптации: адаптация LLM под узкую задачу с меньшим объёмом данных, техники instruction tuning, RLHF — обучение с подкреплением с человеческой обратной связью.

Мульти‑модальные модели

— Модели, работающие с несколькими модальностями одновременно: текст+изображение, аудио+текст. Такие модели открывают новые приложения, но требуют продвинутой подготовки данных и архитектур.

Реинфорсмент‑лёрнинг (RL)

— Обучение через взаимодействие с окружающей средой и систему вознаграждений. Полезно для задач, где важны последовательные решения и долгосрочные эффекты.

Federated learning и приватность

— Обучение без централизованного хранения данных: модели обучаются на устройствах пользователей, а затем агрегируются. Снижает риск утечки данных, но усложняет процесс обучения.

Методы оптимизации и аппаратного ускорения

— Использование TPU, GPU, распределённое обучение, техники квантизации и прунинга для ускорения обучения и вывода.

Облако и специализированные сервисы

— Готовые API для LLM и генеративных моделей сокращают порог входа, но накладывают ограничения на контроль и стоимость.

Ресурсы, сообщества и где практиковаться

Учиться нужно в сообществе: так знания усваиваются лучше, и появляются возможности сотрудничества.

Образовательные ресурсы

— Онлайн‑курсы: платформы предлагают курсы от основ до продвинутых тем.

— Книги для начинающих и продвинутых — список классических учебников в области машинного обучения и глубокого обучения.

— Документация библиотек — официальный источник самой актуальной информации.

Площадки для практики

— Публичные датасеты — репозитории с разнообразными наборами данных.

— Конкурсы и соревнования — площадки для практики, проверки навыков и сравнения с другими участниками.

— Open‑source проекты — участие в разработке реальных проектов даёт ценный опыт.

Сообщества и поддержка

— Местные митапы, конференции, онлайн‑форумы, чаты и рассылки. Общение с практикующими позволяет быстрее решать проблемы и получать обратную связь.

На что обращать внимание при выборе материалов

— Актуальность: технологии быстро меняются — ищите свежие материалы.

— Практическая направленность: теории недостаточно — выбирайте курсы с проектной частью.

— Поддержка: ищите сообщества и наставников, которые помогут при застревании.

Конкретный план на 3/6/12 месяцев

Ниже приведен практический шаг за шагом план для тех, кто хочет системно прокачаться и создать минимум один рабочий проект.

0–3 месяца — базовый уровень и первые проекты

— Освойте основы Python и работу с библиотеками для данных: NumPy и pandas.

— Изучите основы статистики и вероятности на прикладном уровне.

— Пройдите вводный курс по машинному обучению.

— Сделайте 1–2 простых проекта: классификация текстов или прогнозирование на табличных данных. Важнее пройти весь цикл, чем получить идеальную модель.

— Начните вести дневник экспериментов: фиксируйте гипотезы, настройки и результаты.

3–6 месяцев — углубление и развертывание

— Освойте scikit‑learn глубже и изучите хотя бы одну библиотеку глубокого обучения (PyTorch или TensorFlow).

— Разработайте проект, где модель разворачивается как сервис (микросервис или простой API).

— Начните изучать практики MLOps: логирование, простейший мониторинг.

— Изучите принципы ответственного ИИ и создайте документацию для своей модели.

6–12 месяцев — продвижение и специализация

— Реализуйте проект со сложными данными: изображениями, текстом или мульти‑модальной задачей.

— Изучите методы тонкой настройки моделей и оптимизации.

— Освойте контейнеризацию и CI/CD для моделей.

— Участвуйте в open‑source проекте или соревновании и публикуйте результаты.

Советы по дисциплине и мотивации

— Учитесь системно: выделяйте регулярное время на практику.

— Разбивайте большие цели на маленькие шаги и отмечайте прогресс.

— Не стремитесь сразу к совершенству — цель «работающий прототип» полезнее «идеальной теории».

Заключение: как не потеряться и идти дальше

Создание моделей искусственного интеллекта — это сочетание теории, практики, дисциплины и ответственности. Начать можно с малого: базовые знания Python и понимание данных дают возможность сделать первый проект уже в первые месяцы. Затем важно углубляться в машинное обучение, осваивать инструменты глубокого обучения и приобретать навыки развёртывания и эксплуатации моделей. Не менее важной частью является осознание этики и ответственности — модели действуют в мире, где ошибки имеют реальные последствия.

Ключевые принципы для успешного старта:

— Учитесь через проекты: теория важна, но практика закрепляет навыки.

— Фокусируйтесь на данных: понимать данные — значит предсказывать, где появятся проблемы.

— Документируйте и автоматизируйте: это ускоряет прогресс и снижает риски.

— Работайте в сообществе: общение с практикующими даёт обратную связь и новые идеи.

— Думайте о последствиях: ответственный подход делает ваши проекты полезными и устойчивыми.

Этот путь требует времени, но он открыт для каждого, кто готов вкладывать усилия. Начните с первого шага — изучите основы и сделайте простой проект. Затем идите дальше, шаг за шагом, и вы сможете создавать собственные модели искусственного интеллекта (ИИ), которые несут практическую ценность и работают безопасно и ответственно.